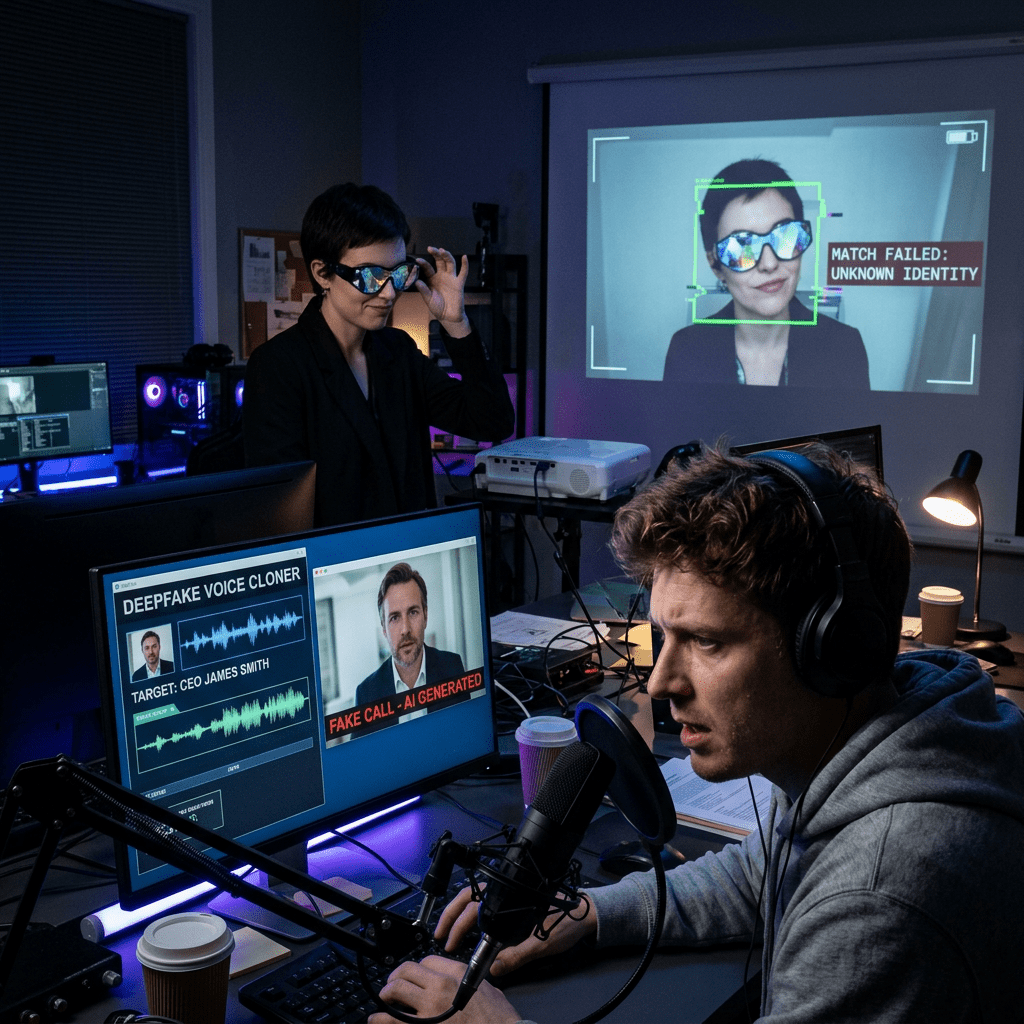

El fraude de identidad no es nuevo. Lo que sí está cambiando de forma significativa es su capacidad para aprovechar señales que hasta ahora se consideraban especialmente fiables, como una llamada telefónica con una voz conocida o la validación biométrica de un rostro. ESET, compañía líder en ciberseguridad, advierte del avance de la IA generativa en este cambio y cómo está obligando a revisar algunos supuestos básicos sobre cómo se verifica hoy la identidad.

“La cuestión de fondo no es únicamente que existan deepfakes o herramientas de clonación, sino que estas tecnologías están rebajando la barrera técnica, reduciendo costes y aumentando el realismo con el que puede simularse una identidad”, señala Josep Albors, director de Investigación y Concienciación de ESET España. “En la práctica, eso permite que ataques ya conocidos evolucionen hacia escenarios mucho más convincentes y difíciles de detectar, tanto para las personas como para ciertos sistemas automatizados”.

La voz como mecanismo de autoridad y como superficie de ataque

En el ámbito corporativo, la clonación de voz resulta especialmente preocupante porque no ataca solo a la tecnología, sino también a la cultura organizativa. Una petición urgente atribuida a un CEO, a un director financiero o a un proveedor de confianza puede activar decisiones rápidas precisamente porque encaja con dinámicas habituales de jerarquía, urgencia y confidencialidad.

Tal y como explica ESET, hoy puede bastar con una breve muestra de audio obtenida de una entrevista, una conferencia, una publicación en redes o una intervención pública para generar una voz sintética creíble. A partir de ahí, el atacante puede dirigirse a perfiles concretos dentro de la empresa, como personal de finanzas, administración o soporte, para solicitar una transferencia, un cambio de cuenta bancaria, un reseteo de contraseña o una modificación de factores de autenticación.

Lo relevante no es solo la posibilidad de imitar una voz, sino la combinación entre esa imitación y técnicas clásicas de ingeniería social. ESET subraya que las herramientas actuales ya son capaces de introducir pausas, muletillas, irregularidades y ruido de fondo para hacer la suplantación más creíble.

El reconocimiento facial también merece una revisión crítica

El segundo gran frente señalado por ESET afecta a la biometría facial. La expansión del reconocimiento facial en procesos de onboarding bancario, validación de identidad y vigilancia ha consolidado la idea de que el rostro constituye una prueba robusta y difícil de falsear. Sin embargo, las pruebas realizadas por Jake Moore, Global Cybersecurity Advisor de ESET, apuntan a una realidad más frágil cuando estos sistemas se someten a condiciones adversariales.

En uno de sus experimentos, Moore utilizó gafas inteligentes modificadas capaces de identificar personas en tiempo real a partir de sus rostros y cruzar esa información con datos públicos disponibles online. En otro, creó mediante imágenes generadas por IA un rostro ficticio que fue aceptado por un sistema bancario de reconocimiento facial y eKYC como si perteneciera a una persona real, lo que permitió abrir una cuenta bancaria auténtica. Tras la demostración, la cuenta fue cerrada y la información compartida con la entidad afectada.

En una tercera prueba, Moore logró evitar ser reconocido por un sistema de vigilancia facial en una estación de tren de Londres utilizando software de intercambio de rostro en tiempo real que superponía sobre su imagen la de Tom Cruise en la señal captada por cámara. El sistema no lo identificó ni lo marcó.

Más que episodios aislados, estas pruebas plantean una cuestión de fondo para la conversación pública y empresarial: qué nivel de confianza es razonable depositar en sistemas biométricos cuando se utilizan como factor principal o único de validación.

Además, este fraude no solo afecta a grandes empresas: también pone en el punto de mira a las pymes. De hecho, el INCIBE ya lanzó en julio del año pasado una alerta específica sobre este tipo de estafa dirigida a pequeñas y medianas empresas en España. Además, este abril la Policía Nacional advirtió de un repunte en Galicia de ciberestafas basadas en la suplantación de identidad, entre ellas la estafa del CEO, que busca presionar a empleados para realizar transferencias urgentes y confidenciales.

Reforzar personas, procesos y tecnología

Ante este escenario, ESET defiende un enfoque basado en personas, procesos y tecnología.

- Personas: la formación debe actualizarse para incluir simulaciones de deepfake de voz y escenarios realistas de fraude biométrico. Ya no basta con enseñar phishing tradicional: los empleados deben aprender a identificar señales de alerta en llamadas aparentemente legítimas, reconocer peticiones de alto riesgo y reaccionar sin dejarse arrastrar por la urgencia o la autoridad.

- Procesos: es clave reforzar la verificación de cualquier solicitud sensible realizada por teléfono mediante canales alternativos, exigir doble aprobación para transferencias de alto importe o cambios en datos bancarios, y establecer preguntas o frases pactadas previamente que permitan validar la identidad de determinados cargos cuando se comuniquen por voz.

- Tecnología: las herramientas de detección de voz sintética pueden añadir una capa extra de protección, pero también es necesario que los proveedores de soluciones de reconocimiento facial y eKYC sometan sus sistemas a pruebas en escenarios adversariales reales, no solo en condiciones de laboratorio. Para ESET, comprobar su resistencia frente a ataques prácticos es imprescindible.